学术会议 | 人机共存的未来攻略

2021年5月7日下午,北京大学博古睿研究中心举办“人机共存的未来攻略”首期工作坊,邀请葛鉴桥、陆俏颖和曾毅三位嘉宾就“如何评估人类与非人类的认知和情感能力”这一问题及其相关理论模型、在实验室与日常生活中相应的实践策略等展开讨论。葛鉴桥提出,人类用以理解人类智能和人工智能的认知神经策略具有差异。陆俏颖讨论了从进化论角度理解的个体性与最小认知之间的关系。曾毅提出了有意识的类脑人工智能模型及其发展蓝图并介绍了研究进展。特邀圆桌嘉宾段伟文、李文新围绕相关问题与三位报告人进行了研讨。

一

葛鉴桥提出,人类用以理解人类智能和人工智能的认知神经策略是不同的。作为社交动物的人对他人的行为十分敏感,仅仅是另一个人的出现就会改变一个人的行为,而及机器/机器人的出现并不会像人出现那样改变人的行为。例如在Kilner等人2013年的实验中,只有当实验主体与另一人的行为不同步时(incongruent),实验主体的行为才会被受到影响;作为对照组,当另一人是机器人,或另一人与实验主体行为同步时都不会受到太大影响。

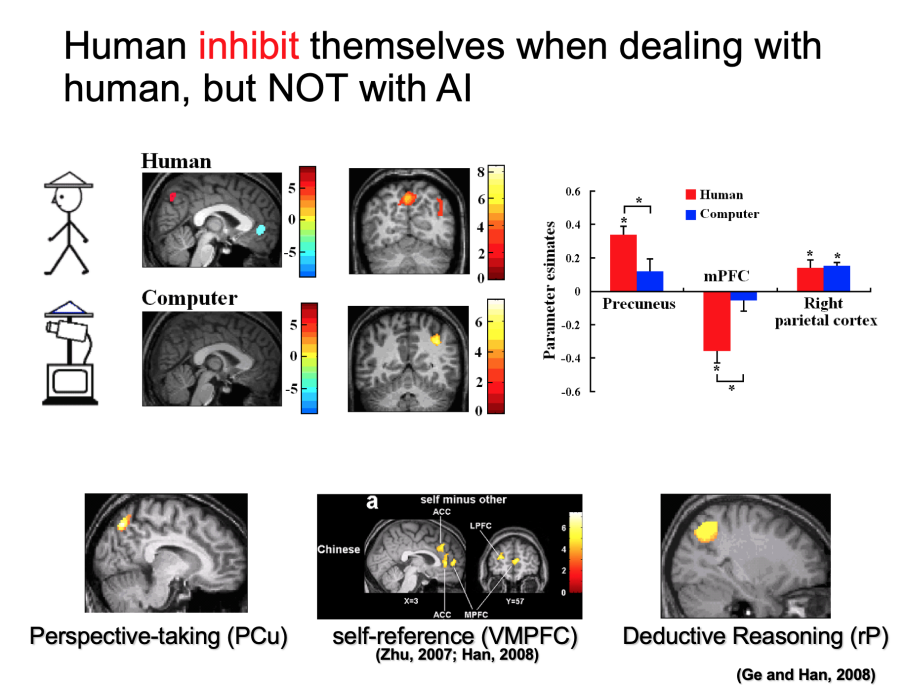

当人们使用功能磁共振成像扫描(fMRI)对大脑进行扫描会发现,被试只有在观看人类(而非机器,卡通或动物)时,拥有“读心功能(mind-reading)”的大脑MPFC区域才会被激活。由此启发,在她与同事于2008年进行的实验区分了Mental Inference (MI),Deductive Reasoning (DR),Perspective Taking (PT) 和Perception (PC) 四种功能,对比被试在理解人和机器时大脑的活动差异,发现人类大脑会在处理与他人相关的事情时自我抑制(inhibit),同样的活动却不会发生在处理与AI相关的事情上。就个人差异来看,拥有更高的PT和自我抑制(self-inhibition)能力的人更能高效地理解他人,但这样的能力在理解AI时并不重要。

也就是说,人类大脑的进化似乎能让人使用特殊机制去理解另一个人,而这样的能力并不会用在理解人工智能上。这或许可以推断——与人工智能下棋的柯洁所使用的策略与他和人类棋手下棋时并不相同;也可以解释为何自闭症儿童无法与他人却能和机器交流,因为他们的PT和自我抑制能力不佳,从而难以理解他人,但和机器交流却不需要这一能力。

这就会带来两个有趣的问题。人在什么时候、什么程度上会认为一个机器是机器?我们会认为类人机器Sophia是机器,那么如果在未来出现了和人类更相似的机器人,我们还会认为ta是机器吗?根据目前的实验显示,10岁儿童的大脑还没有在这方面区分机器和人类的能力,那么人的大脑是在什么时候意识到人和其他智能是有区别的?

当我们考虑到未来时,会产生更多有趣的问题。目前的人类社会有社会心理学和社会神经科学研究,而到了未来——由人类、机器/人工智能和其他动物组成的混合社会,又会产生什么样的研究?显然,我们的孩子已经成长在了这个混合社会中,未来的人类大脑会如何进化?根据Social Brain Hypothesis,人类大脑是用来处理社会信息的,而人类最近一次的关于大脑的基因更新已经是5800年前了,这一切会影响到未来人类大脑的进化吗?

二

陆俏颖从进化论的角度分析了个体性(individuality)和最小认知(minimal cognition)之间的关系。

从方法论上来说,对于认知的探究通常可以分为anthropogenic和biogenic两种进路,前者从人类认知出发推广到普遍的认知概念,是传统研究常用的方法,也是目前AI研究的主流。后者从生命的基本活动出发,逐步扩展到人类认知,Peter Godfrey-Smith是这一进路的近期代表。传统哲学尤其关注“解释鸿沟”问题,即解释特定的物理系统如何可以产生第一人称视角或主观的体验。Biogenic进路将所有的认知现象都视为生物学现象,因此可以绕开解释鸿沟,从第三人称视角试图解释主体性的进化历程。

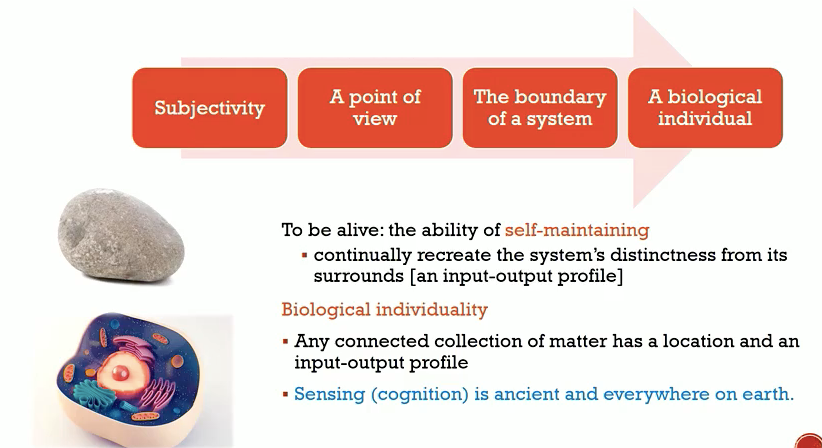

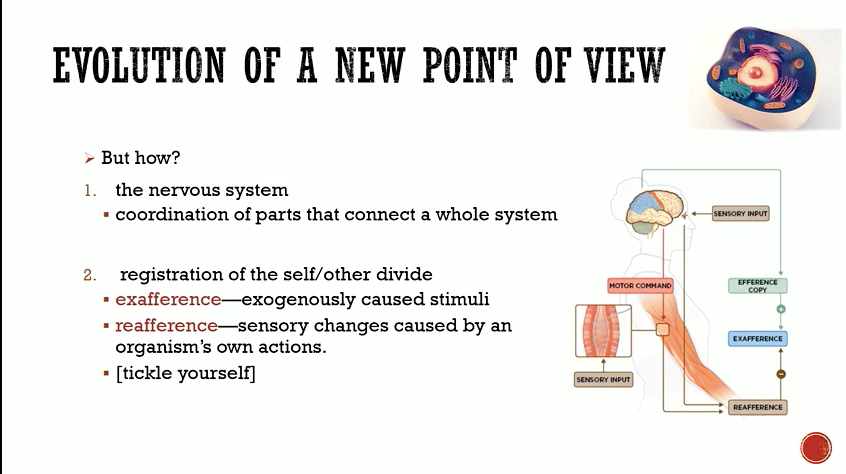

某个系统具有主体性意味着它有一个真正的从内向外的视角,这要求该系统具有区分内部与外部的边界。一般认为,生命现象的特殊之处正是在于生命活动具有区分自我与非我的能力,即生物个体性(biological individuality)。陆俏颖将个体性定义为“any connected collection of matter has a location and an input-output profile”,并且认为,最小化认知伴随生物个体的产生而产生。

以单细胞生物大肠杆菌的趋化作用为例,大肠杆菌可以通控制自己的运动以适应环境。陆俏颖认为,这是最小认知的一个案例。趋化作用的实现过程包括感知(sensing)作为输入和运动(motion)作为输出。这就体现了单细胞生物的个体性。当多个细胞聚集在一起形成一个多细胞聚集体时,第一人称视角或主体性需要以不同的方式实现。另外,有些多细胞聚集体的个体边界并不容易划分,最典型的如蜂群、肠道共生细菌的存在等。陆俏颖对此作出了澄清,她认为,生物个体性并非由确切的物理边界来划分,而是通过动态的认知功能不断强化着系统的边界。换句话说,生物个体应该被视为功能性个体。

陆俏颖对于生物个体性与最小认知的想法还会推出一个与机器认知相关的后果。在生物学中,对于任何一个生物性状,我们可以问两类问题:“为何”和“如何”,分别讨对应功能性解释(即进化的历史)和机制性解释(即它如何作用)。因为同一个功能理论上可以由不同的结构实现,又因为个体性是一个功能定义,所以陆俏颖认为,不能排除机器具有真正的主体性或第一人称视角的可能性,即便机器的主体性会与人类自身所熟悉的主体性非常不同。

三

随后,曾毅介绍了有意识的类脑人工智能(Brain-inspired Artificial General Intelligence)和其背后的人机共存理念。

实际上,目前通过行为模仿(behavior simulation)发展人工智能是有风险的。生物表面的行为和产生行为背后的机制可能很不同,因此,仅停留在行为模仿阶段并不是实现真正意义人工智能的有效途径。机器学习不同于人工智能,智能需要在交互环境中进化,而专注于机器的“学习”过程是远远不够的。人类拥有现在的智能是通过对变化环境的适应,数亿年的演化而得来,而自适应能力恰恰是目前的人工智能所缺乏的。通过机器学习实现的人工智能可能在某一方面有超出人类的能力,但如果发展为通用人工智能(AGI)则会给人机交互带来很大的风险——它们并不懂人类的真实意图。目前在中国,人工智能常被视作人类的工具,在日本,许多人视人工智能为可能的伙伴,许多科幻小说常将人工智能视为竞争者或者敌人。这背后隐藏着一个问题:研发作为工具和作为伴侣的理论和算法应当是不同的,而实际上日本所运用的算法和西方相似,都是将机器视作工具,而作为伙伴的人工智能需要基于“自我”的“理解”能力。

AI的通用性(generality)是有用的,但真正的通用人工智能并不是必要的而且甚至是危险的,例如类人的负面情绪对人类社会将是一个重大风险。此外,真正应该用来区分AI的标准并不应该是目前所常见的“是否具有通用性”,而是AI与它们自己以及和人类的关系,人工智能是否具有“自我”以及“共情”应当是区分人工智能水平的重要标志。此外曾毅还提到赵汀阳提出的人工智能自反性(reflexivity)。并担忧具有自反性的人工智能在网络结构自主演化、机器语言自动生成等领域已经开始出现,而人工智能技术界对其中的风险却几乎没有任何准备。

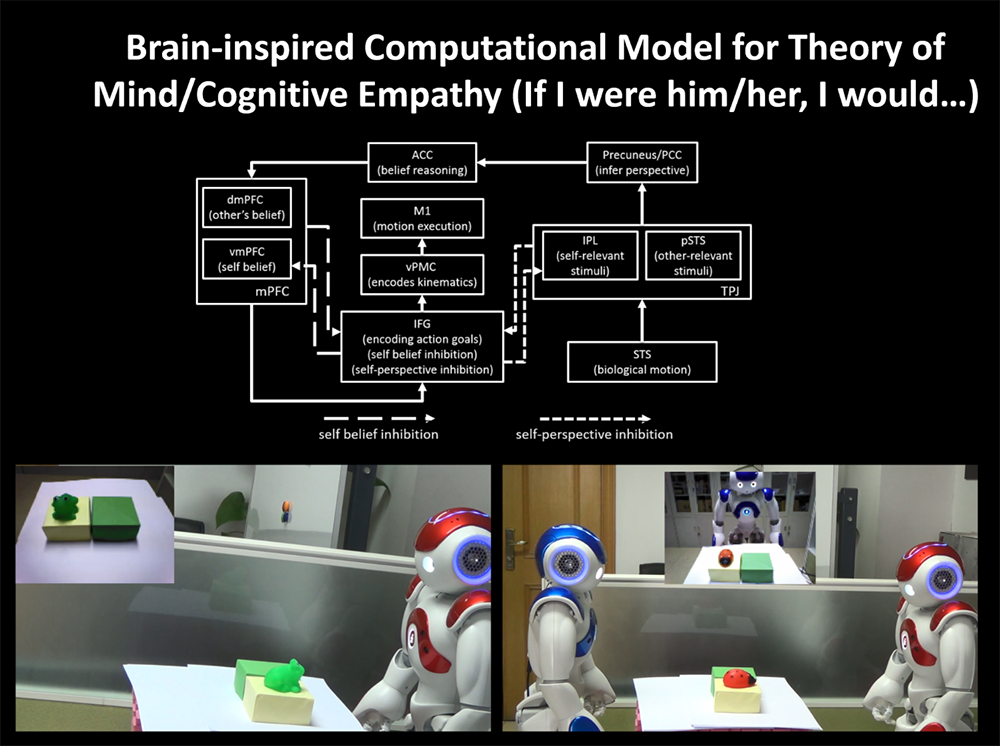

此外,曾毅提出,具有自我感知和共情的人工智能并不会给人类带来更多的风险,恰恰是没有自我感知和共情的人工智能会由于无法产生真正的理解而对人类构成威胁。研发具有自我意识的类脑人工智能(Brain-inspired self-conscious AI)应当从拥有身体感知、获得自身经验、获取动机、价值观、产生个人目标和意愿、区分自我与他人、再到将其他主体视为类似自己的主体,直到产生对他人的同理心。这是一个自我从客体化的“me”到主体化的“I”的过程,即从拥有一组关于自己的观念(idea)到拥有作为自我的经验(experience)。

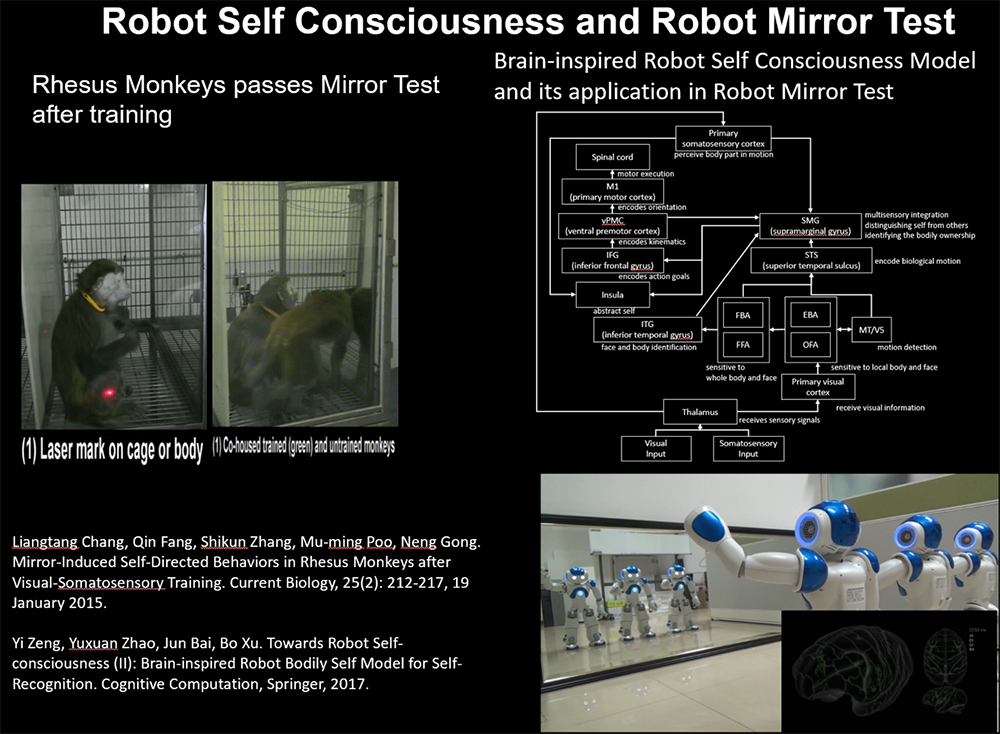

通过曾毅自己课题组的研究工作,机器人通过镜面测试展现出了看似具有自我意识能力的行为,但曾毅认为这并不意味着机器人具有了自我意识。诚然,这会带来对认知科学的挑战——通过镜面测试不再是具有意识的黄金标准。但这不妨作为一种对神经科学的反馈。

曾毅介绍他的实验室通过类脑人工智能的研究希望探索智能的起源,寻找智能进化的原则并预测和实现未来的智能进化。在这一发展过程中,利他主义(altruism)成为至关重要的元素。曾毅展示了他们实验室通过自我经验和认知共情类脑智能模型实现了初步的智能体利他行为。

最后曾毅提出:未来的超级智能很有可能会通过将机器的人类化(Humanization of machine)或者将人类机器化(mechanization of human)实现,从回答“他们是谁”和“我们是谁”到我们一起回答 “新的我们将会成为谁”。因此,我们如何对待未来具有自我和共情的机器人变得十分重要,科学家们会像对待人类的婴儿一样对待他们研发的机器人吗?或许,仅有人与机器的和谐(harmony)才能优化人类与AI的共生,我们期待未来人类、动物和人工智能可以和谐地生活在一个可持续的共生社会中。

简介

活动主办方:

博古睿研究院中国中心

机构

活动时间:

2021-05-07

活动地点:

线上会议

活动状态:

已结束

视频